이런 경우 텍스트 프롬프트에 더해서 이미지를 입력하는 소위 Img2Img 기능을 사용하면 시간을 크게 절약할 수 있습니다.

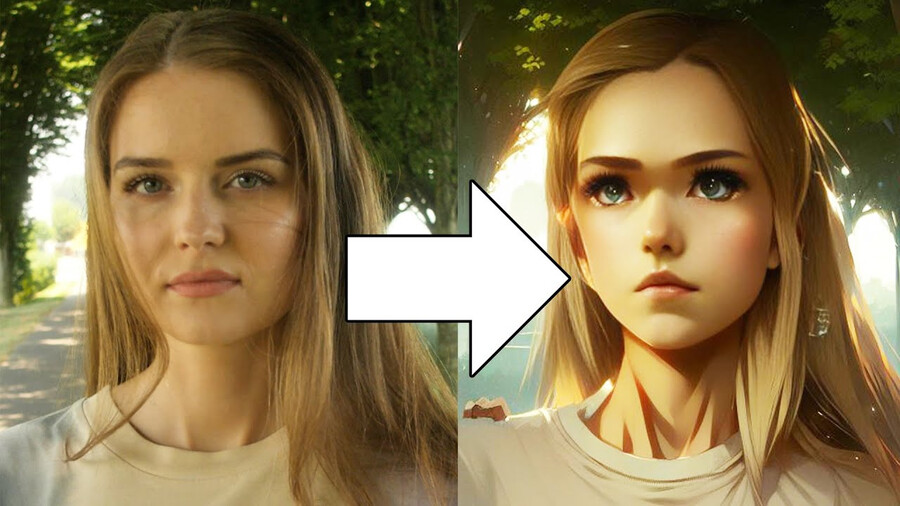

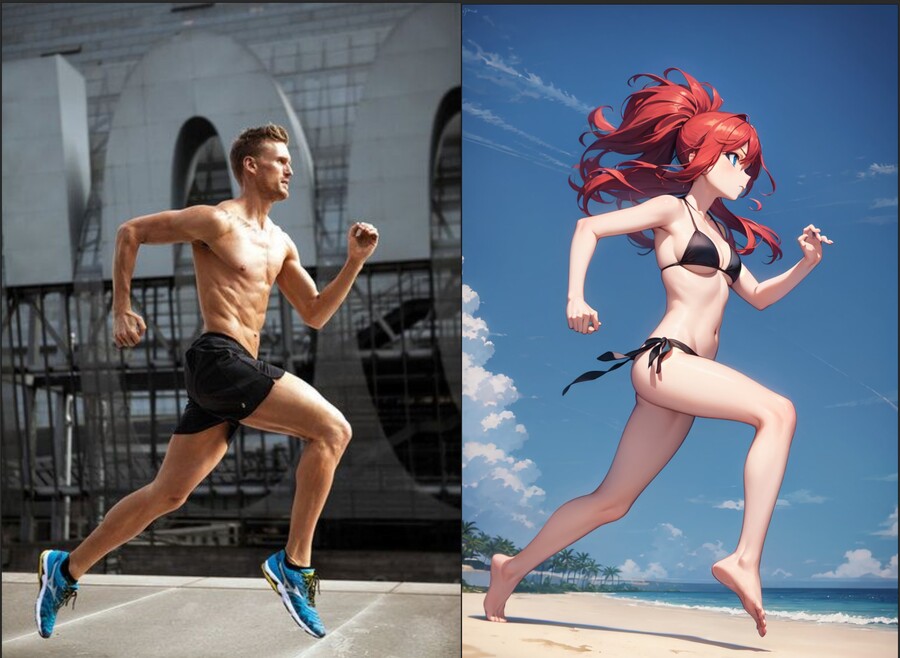

원본 이미지 / Img2Img로 변환한 AI 이미지

하지만 Img2Img의 구조상 원본 이미지의 색상 구성에 크게 영향을 받기에 완전히 다른 분위기의 이미지를 생성하려면 디노이징 강도(Denoising)를 높게 설정할 필요가 있습니다,

물론 디노이징 강도가 높아질수록 원본과 점점 다른 포즈와 구도의 이미지가 생성되기 때문에 생각보다 쉽지가 않습니다.

아래 이미지를 보면 복장과 헤어스타일, 배경에 유의미한 변화가 생기는 디노이징 0.75부터는 원본의 구성과 포즈가 거의 남아있지 않습니다.

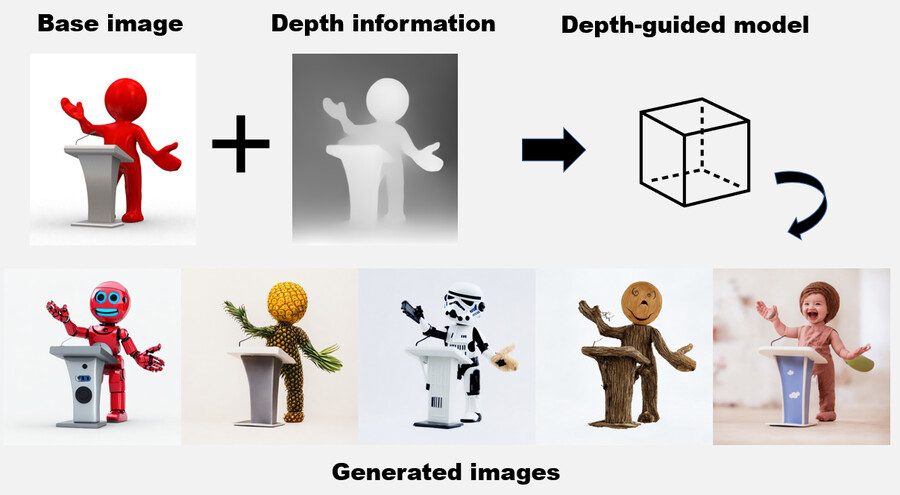

이럴 때 유용한 것이 Depth-guided model 입니다.

입력된 이미지의 구성을 나타내는 Depth(깊이 값)를 추가적으로 입력하는 것을 통해 높은 디노이징 강도에서도 원본 이미지의 구성을 유지하는 것을 가능하게 하는 특화 모델로, Stable diffusion 2.0과 같이 공개되었습니다.

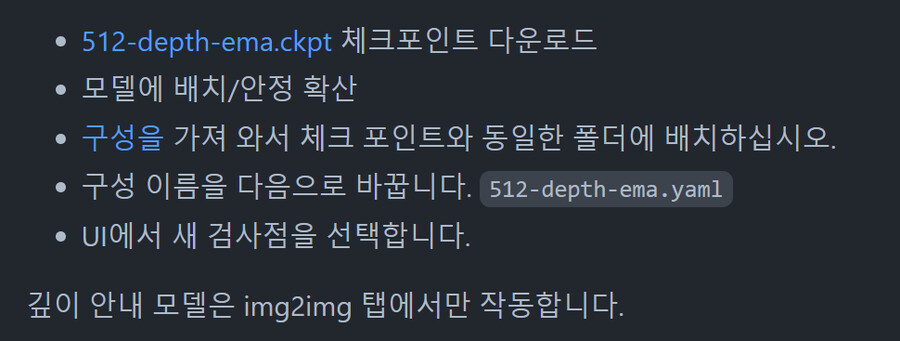

사용법은 간단합니다.

(Automatic1111 webui 기준 : AUTOMATIC1111/stable-diffusion-webui: Stable Diffusion web UI (github.com))

아래의 링크에서 모델과 Yaml 파일을 다운 받아서 같은 이름 (예 : 512-depth-ema.ckpt, 512-depth-ema.yaml)로 변경한 다음 일반 모델들과 같은 경로에 넣고 사용하면 됩니다.

Depth 모델은 Img2Img 탭에서만 정상적으로 작동합니다.

모델 : stabilityai/stable-diffusion-2-depth · Hugging Face

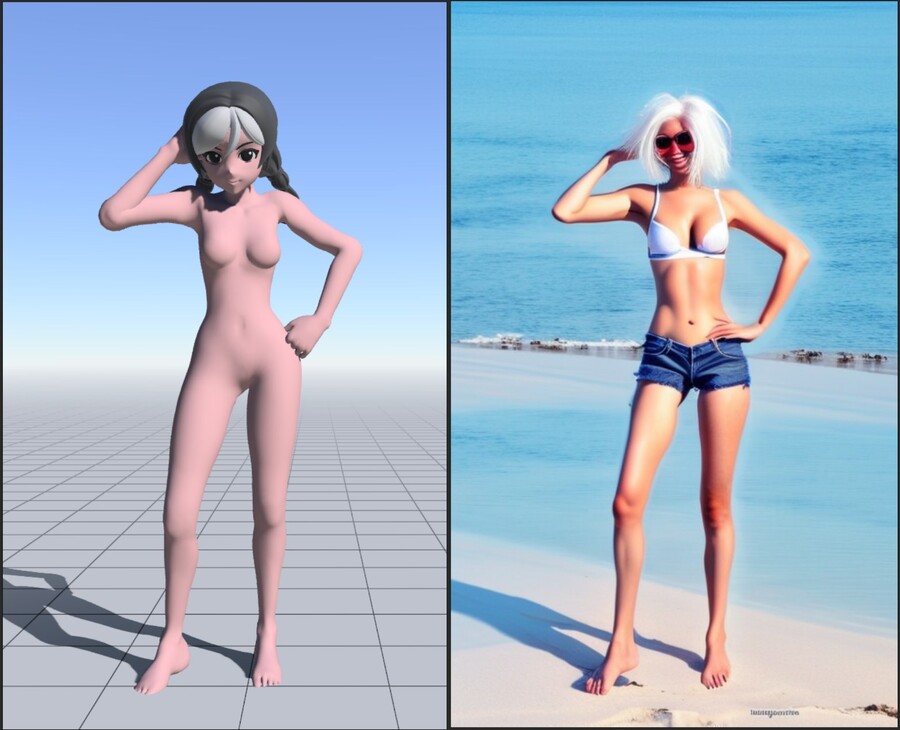

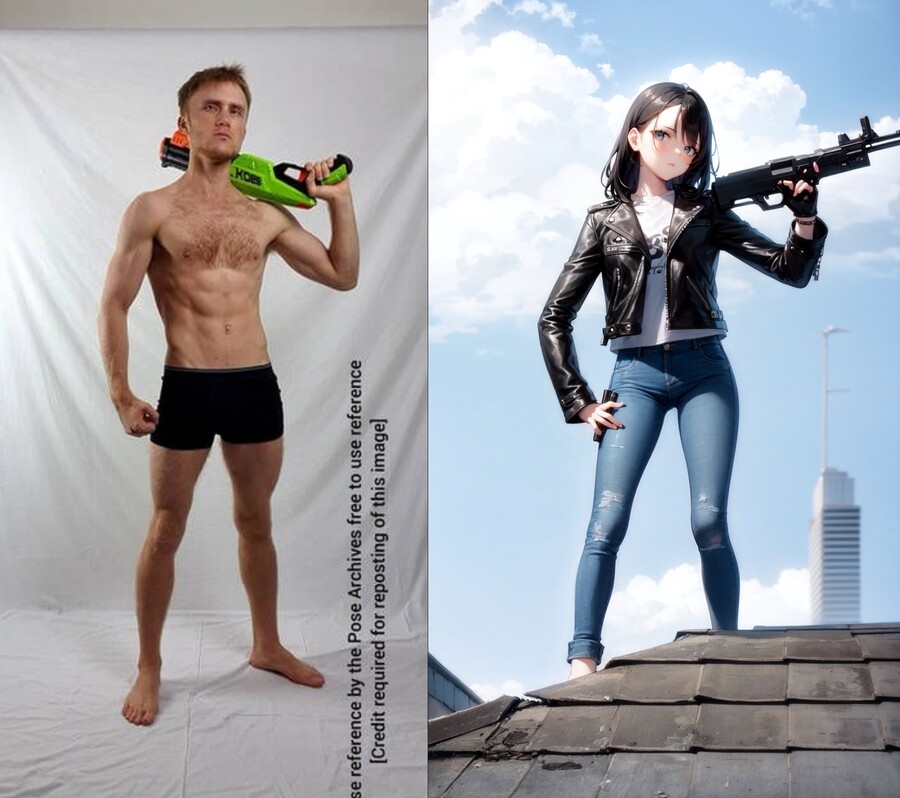

이제 아래 이미지처럼 높은 디노이징 강도(1.0)에서도 원본 이미지의 포즈와 구성을 유지하는 것이 가능해졌습니다.

하지만 실사 위주인 SD가 베이스라 우리가 원하는 2D 일러스트하고는 거리가 좀 있습니다.

이제 Depth 모델로 생성한 이미지에 일반 2D 모델을 사용해서 낮은 디노이징 강도로 Img2Img를 추가로 실행하면 꽤 그럴싸한 이미지가 완성됩니다.

아래 이미지에서 보이는 것처럼 입력된 원본 이미지를 기반으로 생성된 Depth 맵이 새로운 이미지의 청사진이 됩니다.

물론 어디까지나 Depth 값을 기준으로 작동하는 것이기 때문에 전체적인 덩어리를 제외한 다테일한 정보는 생략됩니다.

따라서 원본 이미지의 퀄리티가 좋을 필요가 없고 매직포저 같은 단순한 3D 포징 프로그램의 스크린샷으로도 충분합니다.

매직 포저 웹 : https://webapp.magicposer.com/

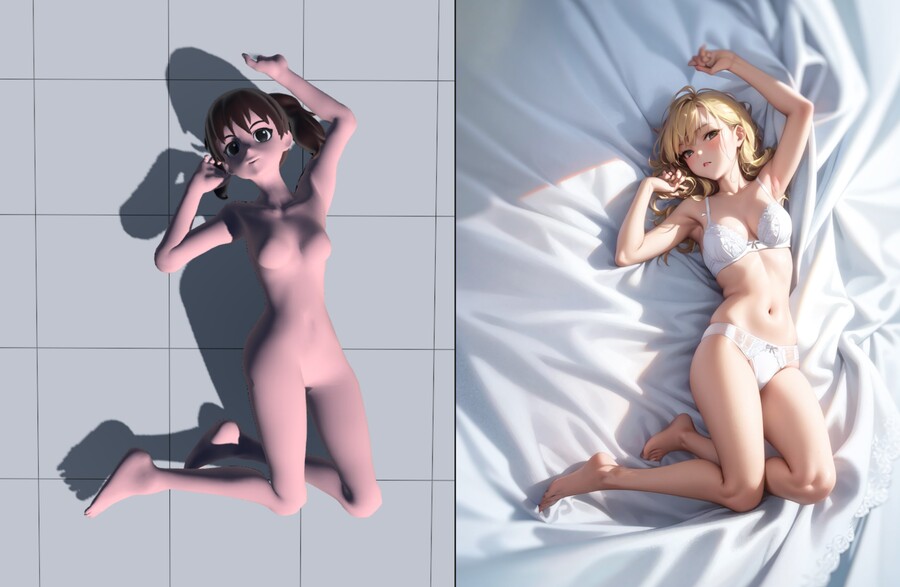

지금까지 설명한 방법을 활용해서 생성한 이미지들의 예시는 아래와 같습니다.

원본 이미지 / Depth 모델 사용 이미지

(IP보기클릭)183.102.***.***

진짜 이렇게 활용하면 좋겠다... 했는데 그러고 있군. 두렵다

(IP보기클릭)223.38.***.***

진짜 타이밍이네 여론 안좋을때는 결국 그림 긴빠이아님?? 이러는데 지금은 추천이 더 많네ㅋㅋㅋㅋ

(IP보기클릭)118.33.***.***

실제로 요즘 유투브 쇼츠 보다보면 AI만 사용해서 댄스 영상 뽑은 AI 숏애니 자주 나옴

(IP보기클릭)14.5.***.***

그냥 자기가 뽑은 그림 올리는 글도 느낌표받을때가 있는가 하면 그냥 칭찬만 받을때도 있음

(IP보기클릭)223.38.***.***

비추를 이래 줘야할 거리인가 이거

(IP보기클릭)112.153.***.***

Ai를 싫어하는 사람도 있으니까

(IP보기클릭)14.32.***.***

이건 캐릭터 디자인도 디자인인데 배경 퀄리티랑 광원 수준이 미친 것 같다

(IP보기클릭)106.101.***.***

(IP보기클릭)183.102.***.***

진짜 이렇게 활용하면 좋겠다... 했는데 그러고 있군. 두렵다

(IP보기클릭)112.153.***.***

저게 애니메 풍으로 파인튜닝된 모델에서 구현이 안되던 거 같던데, 저걸 그냥 sd2 모델을 써서 해결을 해버리네.... | 23.01.21 23:56 | | |

(IP보기클릭)222.114.***.***

(IP보기클릭)222.96.***.***

(IP보기클릭)59.86.***.***

(IP보기클릭)59.86.***.***

아, 어차피 노이즈 기반이라 그림체가 자꾸 바뀌어서 불안정하긴 하겠구나 | 23.01.21 23:44 | | |

(IP보기클릭)118.33.***.***

Chaika_Trabant

실제로 요즘 유투브 쇼츠 보다보면 AI만 사용해서 댄스 영상 뽑은 AI 숏애니 자주 나옴 | 23.01.21 23:45 | | |

(IP보기클릭)211.221.***.***

https://www.youtube.com/watch?v=Cm_95L5vm2g 수많은 별도의 vfx 작업이 있었지만 ai 많이 사용한 영상 | 23.01.21 23:49 | | |

(IP보기클릭)112.160.***.***

https://www.youtube.com/watch?v=tVRL5OsKrJI&list=LL&index=1 | 23.01.22 00:01 | | |

(IP보기클릭)121.162.***.***

이미지가 일관성 없이 생성되는 문제는 동일합니다. 그래도 드림부스 등으로 특정 캐릭터를 학습하면 그럭저럭 볼만해집니다. https://bbs.ruliweb.com/community/board/300143/read/58923623?search_type=member_srl&search_key=3533827 | 23.01.22 01:00 | | |

(IP보기클릭)180.68.***.***

(IP보기클릭)112.153.***.***

(IP보기클릭)222.120.***.***

(IP보기클릭)220.123.***.***

(IP보기클릭)223.38.***.***

진짜 타이밍이네 여론 안좋을때는 결국 그림 긴빠이아님?? 이러는데 지금은 추천이 더 많네ㅋㅋㅋㅋ

(IP보기클릭)14.32.***.***

가슴 크고 이쁜 캐릭 나오면 일단 좋은 소리가 먼저 나올 확률이 높드라 | 23.01.21 23:49 | | |

(IP보기클릭)14.5.***.***

왜서요

그냥 자기가 뽑은 그림 올리는 글도 느낌표받을때가 있는가 하면 그냥 칭찬만 받을때도 있음 | 23.01.21 23:50 | | |

(IP보기클릭)14.32.***.***

이건 캐릭터 디자인도 디자인인데 배경 퀄리티랑 광원 수준이 미친 것 같다

(IP보기클릭)112.153.***.***

사진을 기반으로 학습된 정보를 가지고, 애니메 풍 그림을 그릴 때 광원이나 질감을 배치해버리는 거니까... 흠좀무하긴 함 ㅋㅋㅋㅋ | 23.01.21 23:53 | | |

(IP보기클릭)121.162.***.***

최근에는 2D 모델하고 실사 모델을 합쳐서 광원이나 질감, 배경의 퀄리티를 올린 병합 모델들이 인기입니다. 1 : 2D 모델/ 2: 실사 모델 / 2D+실사 모델 | 23.01.22 01:07 | | |

(IP보기클릭)222.101.***.***

(IP보기클릭)221.158.***.***

(IP보기클릭)211.209.***.***

(IP보기클릭)49.173.***.***

(IP보기클릭)58.228.***.***

(IP보기클릭)112.154.***.***

(IP보기클릭)112.153.***.***

루리웹-------------

Ai를 싫어하는 사람도 있으니까 | 23.01.21 23:55 | | |

(IP보기클릭)211.204.***.***

(IP보기클릭)211.204.***.***

첨 나올때부터 저거 이야기 많았는데 같이 이야기한 캐릭터 상하좌우나 3D데이터 넣어서 고정하는것도 금방 나오겠네 아이디어는 진작에 있었으니... 스케치나 채색만 따로 하는건 방식만 바꿔도 지금 대충 비스무레하게 가능하고 | 23.01.22 00:00 | | |

(IP보기클릭)223.39.***.***

(IP보기클릭)14.49.***.***

(IP보기클릭)112.153.***.***

솔직히 이건 딥스 모델이 구현 안됐을 때는 3d 포징을 저렇게 폭넓게 쓸 수 없었으니까 | 23.01.22 00:04 | | |

(IP보기클릭)223.38.***.***

비추를 이래 줘야할 거리인가 이거

(IP보기클릭)222.120.***.***

(IP보기클릭)116.40.***.***

승기를 잡은건진 모르겠는데 실제 필드에선 아직 영향은 미비함 커미션쪽은 모르겟지만 게임이나 웹툰 이쪽은 아직은 ? 하는 분위기 | 23.01.22 00:06 | | |

(IP보기클릭)112.153.***.***

펄끼요오옷펄끼룩끼룩펄끼야아악

저거로 업스케일링이 제대로 되면 충분히 미친 물건이겠다 싶긴함 | 23.01.22 00:10 | | |

(IP보기클릭)222.120.***.***

컨셉아트 , 서양 아트 쪽은 이미 불지옥 펼쳐짐 씹덕도 조만간이지, 무한한 긴빠이 도둑질 앞에서 그저 시간문제일뿐 | 23.01.22 00:11 | | |

(IP보기클릭)211.204.***.***

당연히 아래쪽부터 잠식해 들어오지 지금은 기능이 허접하니까 아무 영향 못끼치는거고 웹소설, 동인게임 이런데나 이용되는거 걍 뿅하고 나오는 식 아니더라도 클립스튜디오같은데 저런 기능기능 부분적으로 떼다 쓰면 안쓰게 될수가 없음 예전에 단계적으로 발전중이구나~했던 네이버 채색AI같은거 처럼 | 23.01.22 00:11 | | |

(IP보기클릭)116.40.***.***

펄끼요오옷펄끼룩끼룩펄끼야아악

포징이야 지금도 3D툴로 포즈잡고 많이 그림 문제는 작가에 맞는 스타일라이즈화를 시키려면 결국 그위에 라인따고 채색다시 하고 해야할거 아님? 게다가 사람들이 진짜 간과하는것중하나가 퀄리티는 사람도 결국 오래 그리면 잘그리게되는데 중요한건 결국 디자인쪽이고 작가 본연의 스타일화인데 작가 본인이 적극적으로 AI화 에 자기그림먹이고 갑옷이나 복식디자인까지 핀포인트로 해낸다? 그럼진짜로 그땐 인류가 밥숟갈을 놔야할때임 | 23.01.22 00:12 | | |

(IP보기클릭)222.120.***.***

캐서디

딸각충 차단 | 23.01.22 00:12 | | |

(IP보기클릭)116.40.***.***

내가 컨셉아트 하는데 사실 나도 한 10년 20년 내가 은퇴할때쯤이면 모른다고 생각하지만 그래서? 지금 내가 벌어먹는데 전혀 지장도 없고 위에서 말햇든 컨셉아트는 그냥 뽕빨나는 그림그리는게 문제가 아니라 핀포인트 디자인을 해야함 클라이언트가 원하는 디자인 그런 핀포인트 디자인을 하고 못하고가 프로와 아마를 가르는거고 그게 AI가 가능하면 밥숟갈 인간들이 놔야하는거임 | 23.01.22 00:13 | | |

(IP보기클릭)112.153.***.***

이 의견에 동감. 한정적인 인물 그림은 ai가 잘 그릴 수 있을 텐데, 다양한 인물이나 배경 요소를 수정해야하는 컨셉아트는 레이어 따놓지 않으면 수정이 엄청 어려울거니까 | 23.01.22 00:17 | | |

(IP보기클릭)116.40.***.***

갠적으로 좋은 그림 나쁜그림은 없다고 생각하고 그림자체를 열심히하는건 무조건 좋다고 생각하는 입장인데 이글 쓴친구도 예전에 그림보면 열정이있게 그렸는데 AI보고 그냥 마음이 무너진 빛바랜자 같아서 안타까울뿐임 뭐 어쩌겠음 평생 창작이란걸 하고 싶었는데 100도를 못넘겨 끓어오르지 못한 안타까운 아마추어의 다른 길의 말로같아서 안타까울뿐 페북에서도 실력 별로 안좋은 사람이 AI그림으로 좋아요 먹고나서 흑화한거보고 진짜 안타깝게 느껴졌는데 뭐 나도 10년넘게 해먹었으니 대충 10년만 해먹다 다른일하면되니 요즘은 이런 친구들 보면 그저 불쌍할뿐 그림도 잘그리는 애들이 AI를 잘쓰지(실제로 AI이용해서 고퀄작업을 양산하는 지인들도 이미 있음 ) AI에만 의존하는 친구들은 결국 그냥 아마추어로만 남을거같음 | 23.01.22 00:21 | | |

(IP보기클릭)112.153.***.***

사실 저 딥스 모델 써서 프롬프트로 캐릭터를 마네킹으로 뭉개면서, 고퀼 배경만 뽑은 후에 덧그리는 식으로도 활용가능 할 테니.... 아니면 이미 완성된 작업물 업스케일링하는 형태로 디테일이나 질감, 광원을 더하는 방법으로도 쓸 수 있을테고... | 23.01.22 00:27 | | |

(IP보기클릭)116.40.***.***

ㅇㅇ 당연함 그리고 그림을 잘그리는 사람들은 그걸 더 쉽게 이용해먹지 단순한 라이팅외에 색온도차로 인한 대비를 이용한 화면구성이나 온갖 축적된 노하우를 쓰면 훨씬 작업에 용이하지 AI를이용한 그림 혐오론자들이 모르는게 그거임 이미 작업자들은 저거 이용해서 더 편하게 빠르게 그림 양산할 생각을 이미 하고잇고 안써도 이미 잘하고있어서 정말 와 이걸 어케써보지 하고 더 돈 많이 벌수잇게되고있는데 AI가 그림그리는 사람이던 뭐던 모조리 대체 하면 정말 그건 인간이 밥숟갈 놓아야 할지 말지 결정할 시기급이라고봄 이미 회계 뉴스등에서도AI 도입을 시도했지만 지지부진한건 뭔가 이유가 잇다고봐서 | 23.01.22 00:32 | | |

(IP보기클릭)112.153.***.***

에러가 나면 위험한 분야는 지지부진할테지만. 예술은 에러가 나도 위험하지 않으니까... | 23.01.22 00:33 | | |

(IP보기클릭)116.40.***.***

그나저나 덕분에 편하게 케릭터 구도 할때 참조할만한 이미지 쉽게 뽑는법 알려줘서 고마움 내가 요새 케릭터는 잘안그리는데 이런거 잘이용하면 갠작할때 편하겠다 외주할때도 예전에 내가 배경처음 이직할때 생각했던 모델링등으로 케릭터 대충 그리고 배경으로 그림뽕빨내기에 새로운 시점이 생기네 잘쓸께 | 23.01.22 00:35 | | |

(IP보기클릭)116.40.***.***

그거보단 효용성은 아는데 기득권이 워낙 센게 문제라고 봄 나는 | 23.01.22 00:37 | | |

(IP보기클릭)121.162.***.***

자기 스타일로 AI 학습하고 있는 작가들도 꽤 있습니다. | 23.01.22 01:18 | | |

(IP보기클릭)175.223.***.***

(IP보기클릭)121.162.***.***

평범하게 라면 먹게된지는 좀 됐습니다. | 23.01.22 01:14 | | |

(IP보기클릭)49.175.***.***

(IP보기클릭)106.101.***.***

(IP보기클릭)121.142.***.***

.. 열심히 따라와보는데.. 여기서 어떻게 해야할지 모르겠습니다... 뭐가 문제일까요? 경로 잘 설정해준것 같은데..

(IP보기클릭)121.162.***.***

yaml파일을 뎁스모델과 동일한 이름으로 변경해서 같은 경로에 배치해야 합니다. yaml 파일 링크 우클릭 - > (으)로 링크 저장을 선택해서 다운 받으시면 됩니다. https://raw.githubusercontent.com/Stability-AI/stablediffusion/main/configs/stable-diffusion/v2-midas-inference.yaml | 23.01.22 16:22 | | |

(IP보기클릭)221.163.***.***

(IP보기클릭)59.8.***.***

(IP보기클릭)218.155.***.***

(IP보기클릭)218.155.***.***

아 그리고 추가로 뎁스로 이미지 뽑을땐 디노이징 0.75로 뽑았고 anything 모델로 뽑을때는 디노이징 0.2로 해봤습니다만.. 이미지와 같이 나오더라구요.. sampling method 은 euler a 로 했습니다 | 23.02.28 18:31 | | |

(IP보기클릭)121.162.***.***

프리프로세서를 언급하시는 것을 보면 컨트롤넷을 설치하신 건가요? 컨트롤넷은 입력된 이미지를 처리하는 프리프로세서가 있고, 처리된 이미지(뎁스, 포즈, 캐니 등)를 다시 각각의 모델에 입력하게 됩니다. 예를들면 뎁스 프리프로세서면 뎁스 모델을 사용합니다. 컨트롤넷의 사용법에 대해서는 이쪽을 참고하세요. https://bbs.ruliweb.com/community/board/300143/read/60397372 | 23.02.28 19:41 | | |

(IP보기클릭)175.195.***.***

| 23.03.01 10:31 | | |

(IP보기클릭)175.195.***.***

| 23.03.01 10:32 | | |

(IP보기클릭)175.195.***.***

이렇게 처리가 되는데.. 제가 이쪽 전문으로 하던사람이 아니였고 맨땅에 헤딩식으로 선생님 글로만 공부하고 있다보니 부족한 점이 너무 많습니다 죄송합니다 ㅠㅠ 컨트롤넷 사용법에 관해서는 오픈포즈,캐니,헤드,뎁스 이렇게 쓰는중인데.. 원하는 캐릭터가 원하는 포즈로 안나오네요 컨트롤넷엔 뎁스로 뽑은 이미지를 넣었고 프리프로세서(뎁스),모델(뎁스)를 넣었습니다 프롬프트는 입력 안했고 스디퓨젼은 애니씽모델을 사용했습니다 여자캐릭터가 뎁스이미지와 같이 정면을 보는 모습을 만들고싶은데 맘처럼 되지않네요ㅠㅠ.. | 23.03.01 10:36 | | |

(IP보기클릭)175.195.***.***

컨트롤넷 사용법글중 위 그림과 같은 설명구간이 있는데 기준이될 일반이미지(img2img2)는 넣지않은상태로 컨트롤넷에만 뎁스이미지를 넣고 프리프로세서 및 모델은 모두 (뎁스)로 입력 긍정프롬프트를 girl 하나만 넣은 상태에서 실행을 하면 아무그림도 나오지않고 실행이 종료가 됩니다 이건 어떤것이 잘못된걸까요?.. | 23.03.01 11:11 | | |

(IP보기클릭)175.195.***.***

출력시 아무이미지도없이 그냥 바로 종료될때 나오는 오류메세지가 AttributeError: 'NoneType' object has no attribute 'convert' 이렇게 나오네요.. 유튜브 찾아보니까 똑같이 따라해도 유튜버는 그림이 뽑히는데 저만 작동을 안하더라구요 컴퓨터 문제일까요; https://www.youtube.com/watch?v=VjAElfAehNw&t=737s 이 영상이 제가 참고한 영상인데 12:17초부터 스크리블 모드를 사용하는걸 알려주는데 따라해도 저는 작동이 안됩니다.. 영상에서는 이미지가 뽑히는데..ㅠㅠ 컴터가 구려서 그런거라면 이해를 하겠는데 뭘 잘못했는지를 모르겟어요.. 오류메세지는 그림 하단에 나와있습니다 | 23.03.01 12:07 | | |

(IP보기클릭)121.162.***.***

일단 사용하신 모델과 프리프로세서 등의 상세한 설정을 스크린샷으로 보여주실 수 있을까요? | 23.03.01 13:44 | | |

(IP보기클릭)175.195.***.***

위에 제가 썻던 상세설정들 스샷을 올려놨습니다. python: 3.10.8 작업 - img2img 스테디퓨젼 모델(webui) - anything_v3_full.sefetensors Sampling method - Euler a Sampling steps - 20 Width -512 Height -512 CFG Scale - 7 긍정프롬프트 - girl 부정프롬프트 - 입력안함 기준이미지 - 하얀머리고양이귀여자 (위댓글중 스샷에 첨부) 컨트롤넷 설정 Preprocessor - 뎁스 Model - control_sd15_뎁스 컨트롤넷이미지 - 스테디퓨젼 뎁스모델로 출력한 이미지(위댓글중 검정티 입고있는 3D 이미지) 시도해본것 - 1.img2img 에서 기준이미지를 넣지않고 컨트롤넷에 뎁스이미지(검정티입은 3d 이미지)를 넣고 프리프로세서에 뎁스,모델에 뎁스 넣음. 프롬프트에 girl 입력 - > 출력 -> 실패 2.img2img 에서 기준이미지(고양이귀여자그림)에 이미지를 넣고 컨트롤넷에 뎁스이미지(검정티입은 3d 이미지)를 넣고 프리프로세서에 뎁스,모델에 뎁스 넣음. 프롬프트에 girl 입력 - > 출력 -> 실패 3.img2img에서 기준이미지 넣지않음-> 컨트롤넷에 프리프로세서에 스크리블,모델 스크리블 넣고, 캔버스에 대충사람그림 그림 -> 출력 -> 실패 이런식입니다 | 23.03.01 18:19 | | |

(IP보기클릭)121.162.***.***

일단 설정에는 문제가 없는 것 같습니다. 컨트롤넷 익스텐션의 버그일 가능성이 있으니 최신 버전으로 업데이트해보세요. | 23.03.01 21:28 | | |

(IP보기클릭)175.195.***.***

문제가 없다는것은.. 시도해본것중 1,2,3번 모두 이미지가 출력됐어야 정상이란 소리인가요?.. 업데이크 체크를 눌렀더니 이렇게 나오는데 싹다 지우고 처음부터 다시 설치를 하는게 맘편한걸까요...ㅠㅠ | 23.03.01 23:09 | | |

(IP보기클릭)121.162.***.***

위쪽만 보고 아래쪽 1~3을 놓쳤네요ㅜㅜ 1, 3번의 경우 img2img에 기준 이미지를 안 넣었으니 오류가 발생하는게 정상입니다. 2번의 경우 첨부 이미지에서 맨 오른쪽 이미지처럼 기준이미지의 색과 뎁스의 형태를 닮은 이미지가 생성되어야 합니다. 정확하게 하시려는 것이 무엇인지 알려주실 수 있을까요? | 23.03.01 23:38 | | |

(IP보기클릭)175.195.***.***

헉.. 제가 원하는 이미지를 뽑으시다니.. 진짜 리스펙합니다..ㅠㅠ 제가 시도한 2번처럼 할경우 첨부해주신 이미지처럼 출력이 되어야 정상이란 소리죠?.. 아무래도 제 컨트롤넷이나 스디퓨전이 오류가 있는거같네요ㅠㅠ 아님 컴터가 구리던가.. 그래픽카드가 RTX 2060super 8vram 이다 보니 한계가 명확한것같네요.. 그리고 말씀해주신 방법대로 업데이트를 해보려고 했으나 현재 최신버진인지 업뎃이 필요한지 자체가 안뜹니다.. unknown 상태에서 변화를 안하네요 손그림엔 재주가 없어서 AI그림을 이용해 이모티콘을 제작하고 싶어하고 있습니다. 선생님께 개인적으로 배우고 싶은데 무슨 방법이 없을까요..ㅠㅠ | 23.03.02 22:25 | | |

(IP보기클릭)121.162.***.***

다른 곳에 문제가 있을 가능성이 있으니 일단 전부 삭제하고 다시 설치해보세요. 중간에 걸리시는 부분이나 궁금한 것이 있으시면 언제든지 쪽지로 연락주시면 됩니다 ㅎㅎ | 23.03.02 23:05 | | |

(IP보기클릭)175.195.***.***

아넵 정말 감사드립니다 계속 열심히 공부하도록 할게요 ㅠㅠ | 23.03.02 23:08 | | |

(IP보기클릭)58.233.***.***

(IP보기클릭)121.162.***.***

최근에는 컨트롤넷을 사용한 뎁스/포즈 이미지 생성이 주로 사용되고 있으니 참고하시기 바랍니다 SD 1.5 모델들과 Lora 모두 사용이 가능합니다. : https://bbs.ruliweb.com/community/board/300143/read/60397372?search_type=member_srl&search_key=3533827 | 23.04.13 01:08 | | |

(IP보기클릭)1.237.***.***

(IP보기클릭)121.162.***.***

본문에서 소개한 방식보다는 컨트롤넷을 사용하는 것을 추천드립니다. https://bbs.ruliweb.com/community/board/300143/read/60397372?search_type=member_srl&search_key=3533827 | 23.04.13 01:09 | | |

(IP보기클릭)112.216.***.***